Blogparade #KIBedenken

Joscha Falck und Nele Hirsch haben zu einer Blogparade aufgerufen. Hintergrund ist, dass bei den beiden angesichts der Debatte rund um den Einsatz von KI im Kontext von Lehr-/Lernprozessen Entwicklungen auftauchen, die Nele und Joscha kritisch sehen. Ich zitiere die Punkte der beiden einmal im Volltext, damit auch die wenigen, die meinen Blog über RSS wahrnehmen nicht allzu viel querlesen müssen:

- In der KI-Debatte geht es zu viel um digitale Tools und um das Zeigen von Anwendungen, die an sich nicht besonders schwer zu bedienen sind. Dazu werden oft ganze Fortbildungstage veranschlagt. Es fehlt damit an Fortbildungszeit für Themen, die pädagogisch und gesamtgesellschaftlich angesichts der Krise unseres Bildungssystems und unserer Gesellschaft deutlich wichtiger wären.

- Der Fokus auf KI als Werkzeug steht dem Fokus auf Lernen im Weg. Aspekte der Kompetenzorientierung werden ebenso (zu) wenig in den Blick genommen wie fachdidaktische Fragen.

- Aufgrund der Omnipräsenz von KI und der erwünschten raschen Anwendung/Implementierung gerät die dringend nötige Veränderung der Lernkultur und Lehr-/Lernkonzepte wie beispielsweise das selbstgesteuerte Lernen oder Individualisierung in den Hintergrund. Die Verknüpfung mit KI scheint oft mehr „pädagogisches Feigenblatt“ als tatsächlicher Veränderungswille zu sein.

- Der empirische Beleg der Wirksamkeit von KI-Tools im Unterricht steht noch aus, weshalb didaktische Empfehlungen und angepriesene Tools aus unserer Sicht mehr Skepsis vertragen könnten.

- Die mit KI einhergehende (zurückgekehrte?) Toolifizierung in der Bildung versperrt den Blick auf die viel wichtigere Frage, wie wir gutes Lernen in einer zunehmend von KI-geprägten Welt gestalten können.

- Im Fokus stehen sehr oft Tools profitorientierter internationaler Konzerne, deren Geschäftsmodelle von Intransparenz geprägt sind. Auch mangels Alternativen fließt derzeit viel öffentliches Geld in privatwirtschaftliche Firmen anstelle Investitionen in eine demokratisch kontrollierte, öffentliche KI-Infrastruktur zu tätigen.

Die kurze Antwort

Das ist alles so. Aber ich weigere mich, das als ein Spezifikum von KI zu sehen. Es gilt für nahezu alle digitalen Entwicklungen, die wir in den letzten Jahren im Kontext von Schule gesehen haben. Man könnte den Begriff „KI“ durch beliebige andere austauschen. Interessant ist für mich vielmehr die Frage, warum sich Strukturen und Diskurse rund um Neuerungen wieder und wieder wiederholen. Die Thesen von Joscha und Nele beschreiben für mich letztlich Phänomene, die wir schon lange kennen.

Wenn man noch weiter abkürzen wollte, müsste man das gesamte Thema letztlich wieder einmal auf Haltung komprimieren.

- Medienbildung ohne informatisches Grundlagenwissen ist möglich, aber in meinen Augen sinnlos. Trotzdem will das Auto immer wieder zwar „gefahren“, aber keinesfalls „verstanden“ werden, weil es ja auf das Fahren ankommt – diese Haltung clasht recht hübsch mit den Anspruch an Mündigkeit im digitalen Raum.

- Mit Phänomenen wie den Outputs von generativer KI lässt sich auf unterschiedlichsten Ebenen viel Geld verdienen, etwa mit Klick&Wisch- oder Superpromptingkursen zu Tools. Dafür gibt es eine Nachfrage, die auch bedient wird, weil alle das Auto möglichst schnell fahren wollen – genau diese Haltung zementiert bestehende Muster.

- Der vorläufige Waffenstillstand mit der Digitalindustrie bestand darin, dass diese z.B. im Messengerumfeld alle Metadaten abgreift und die Inhalte der Nutzer:innen selbst verschlüsselt. Die Verschlüsselung war technisch so konzipiert, dass auch die Anbieter selbst nicht in Inhalte hineinsehen konnten. Die Nutzung von generativer KI in der Breite gewährt der Digitalindustrie jetzt Zugriff auf die Inhalte selbst und zwar auch auf solche, von denen sie bisher nie zu träumen gewagt hätte. Die reinen Autofahrer finden das cool, weil der Asphalt jetzt noch glatter wird. Eine kritische Haltung dazu erfordert recht anstrengend zu erwerbendes Wissen. Warum sollte man den langsamen Feldweg nehmen, auf dem auch noch Krimskrams herumliegt, der das Auto beschädigen kann? Warum selbst korrigieren oder Rückmeldungen geben, wenn doch eine von mir vorgepromptete KI zu 90% immer verfügbar ist und das ermüdungsfrei stoisch erledigt?

Meine Erfahrungen

Ich habe im November 2022 generative KI zu ersten Mal in einer Fortbildung im Kontext zum digitalen Schreiben vorgestellt. Das war wenige Wochen vor dem raketenhaften Aufstieg von ChatGPT. Bei den Teilnehmenden überwog damals das Gefühl des Entsetzens. In der Folge der Allgemeinverfügbarkeit von ChatGPT muss es in Niedersachsen von unterschiedlichen Stellen aus „Order“ gegeben haben, sich mit diesem Thema dienstlich auseinanderzusetzen. Ganz so schlecht scheinen meine Vorarbeiten und Ansichten nicht gewesen zu sein, sodass ich durch sehr viele teilweise sehr einflussreiche Kontexte gezogen bin. Überwog anfangs noch überwiegend die Angst, nunmehr ständig „betrogen“ zu werden verbunden mit dem Ruf nach formalen Lösungen, versachlichte sich das Thema nach und nach. Das ging nach meinem Eindruck bis dahin, dass ich teilweise eingeladen wurde, damit man den formalen Auftrag „von oben“ abgearbeitet hatte, um dann „back to topic“ gehen zu können.

Ich hatte keinen Auftrag, das zu tun, was ich da getan habe. Ich habe es als meinen Auftrag gesehen, Wissen weiterzugeben, mich selbst schlauzumachen und einzuarbeiten und dabei auch die ethische Perspektive mit einzubeziehen. Ich bin in der glücklichen und privilegierten Position, dass das Teil meiner Abordnung als medienpädagogischer Berater ist. Ich muss kein Geld oder Reisekosten nehmen. Das ist alles mit meinem Gehalt und den Reisekostenerstattungen abgegolten.

Aber zu der Sache mit dem Geld kommt noch etwas viel Entscheidenderes als Privileg: Sehr viele Menschen, die sich neben dem Lehrberuf für Fortbildung einsetzen, tun das, weil das ihnen viel Freude und Anerkennung bringt – vielleicht die Freude und Anerkennung, die in Schule selbst manchmal fehlen. Natürlich wird Anerkennung durch Reichweite und Erfüllung von Bedarfen mit erreicht und der Bedarf ist eben in der Breite oft das Autofahren (s.o.) – hier synonym für Toolifizierung stehend. Das trägt mit Sicherheit mit zu den Phänomenen bei, die Joscha und Nele beobachten.

Ich kann aus meiner doppelt privilegierten Position heraus „knötern“ und anderen das Spielzeug „KI“ auch einmal schmutzig machen.

Wie müsste für mich die ideale Fortbildung (nicht nur zu KI) aussehen?

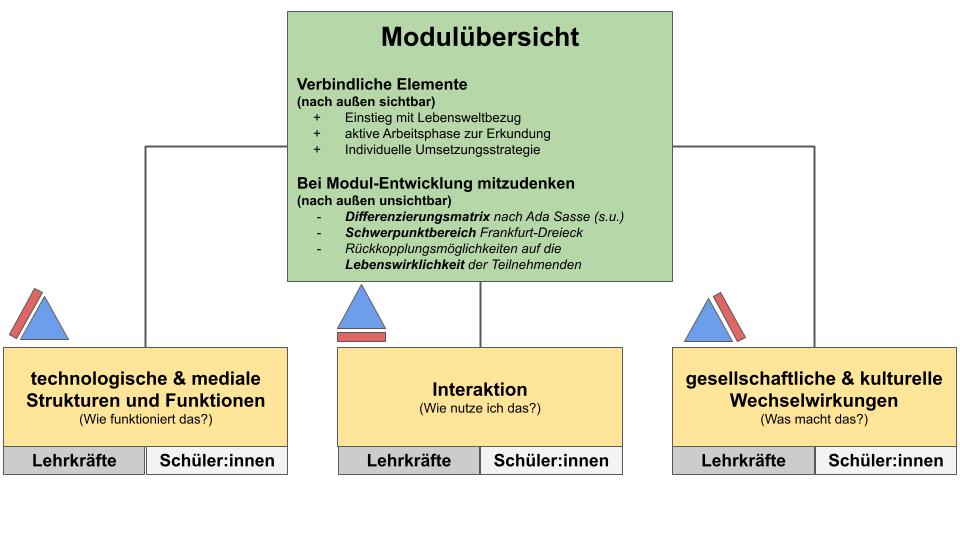

Dazu habe ich zusammen mit einigen anderen ein kleines Schema entwickelt, was sich erstmal nach einer Binse anhört und sich sehr stark an das Frankfurt-Dreieck anlehnt.

Für mich waren daran drei Aspekte neu oder sind mir durch die Arbeit stärker bewusst geworden:

Für mich waren daran drei Aspekte neu oder sind mir durch die Arbeit stärker bewusst geworden:

- Der Lebensweltbezug ist nicht nur für Schüler:innen wichtig.

- Jede Gruppe ist heterogen und erfordert eine innere Differenzierung

- Jede Gruppe hat Kompetenzen, die es zu nutzen und sichtbar werden zu lassen gilt

Ganz platt läuft das in meiner klassischen Fortbildung zu generativer KI folgendermaßen:

- Phänomene (= Produkte) generativer KI zeigen (Audio, Video, Bild etc.)

- Den Entstehungsprozess informatisch entzaubern – es ist letztlich Mathe.

- einige wenige Anwendungsbeispiele für Lernprozesse zeigen

- Unterschiedliche Tools mit unterschiedlichen Anforderungen selbst erkunden lassen

- Erfahrungsaustausch in der Gruppe und Transfer auf Unterrichtssituationen

Ein Seitenhieb zum Thema Demokratisierung von KI

Nele und Joscha beklagen, dass rund um KI das übliche Oligopol der Big5 entsteht und gerade im Bereich der Bildung mehr zivilgesellschaftliche Engagement notwendig wäre – zumindest verstehe ich die beiden so.

Um das Spielzeug schmutzig zu machen: KI ist letztlich nur Mathe, dummerweise immens aufwändige, komplexe Mathematik. Das Training eines Modells wird auf absehbare Zeit nicht zivilgesellschaftlich möglich sein. Alle frei verfügbaren Modelle sind vortrainiert und hinsichtlich ihrer Quellen auch nicht wesentlich transparenter als die kommerziellen Ansätze.

Wir werden als Medienzentrum demnächst eigene KI-Modelle betreiben, von Schüler:innen werden diese allerdings nur unter Aufsicht genutzt werden können, da nicht klar ist, welche Inhalte man diesen Modellen prinzipiell entlocken kann.

Wie komplex das Training eines Modells ist, kann man daran ermessen, dass selbst große Anbieter ihre Modelle nach Möglichkeit nicht mehr anfassen, wenn diese einen gewissen Reifegrad erreicht haben. Stattdessen werden Datenbanken aufgebaut, die Benutzer:innen beim Prompting „unterstützen“ und auch letztlich die ethischen Aspekte „umsetzen“. Das Modell selbst wird nicht mehr angefasst.

Daher ist aus heutiger Sicht aus informatischer Perspektive meiner Meinung nach die Demokratisierung von KI ein nettes Luftschloss. Weder gibt es die notwendigen Rechenkapazitäten noch das Know-How, aus beliebigen spezifischen Trainigsdaten ein stabiles Modell zu erzeugen.

Pingback: Aufruf zur Blogparade #KIBedenken |